arcgis

地图

文件操作

python副业

lua

装饰器

鸿蒙

C语言数组实例

基础入门

测试工具

考试管理系统

batch

系统架构

程序员35

PM项目管理

DBA

多任务学习

符号同步

模块测试

Scratch等级考试真题

语言大模型

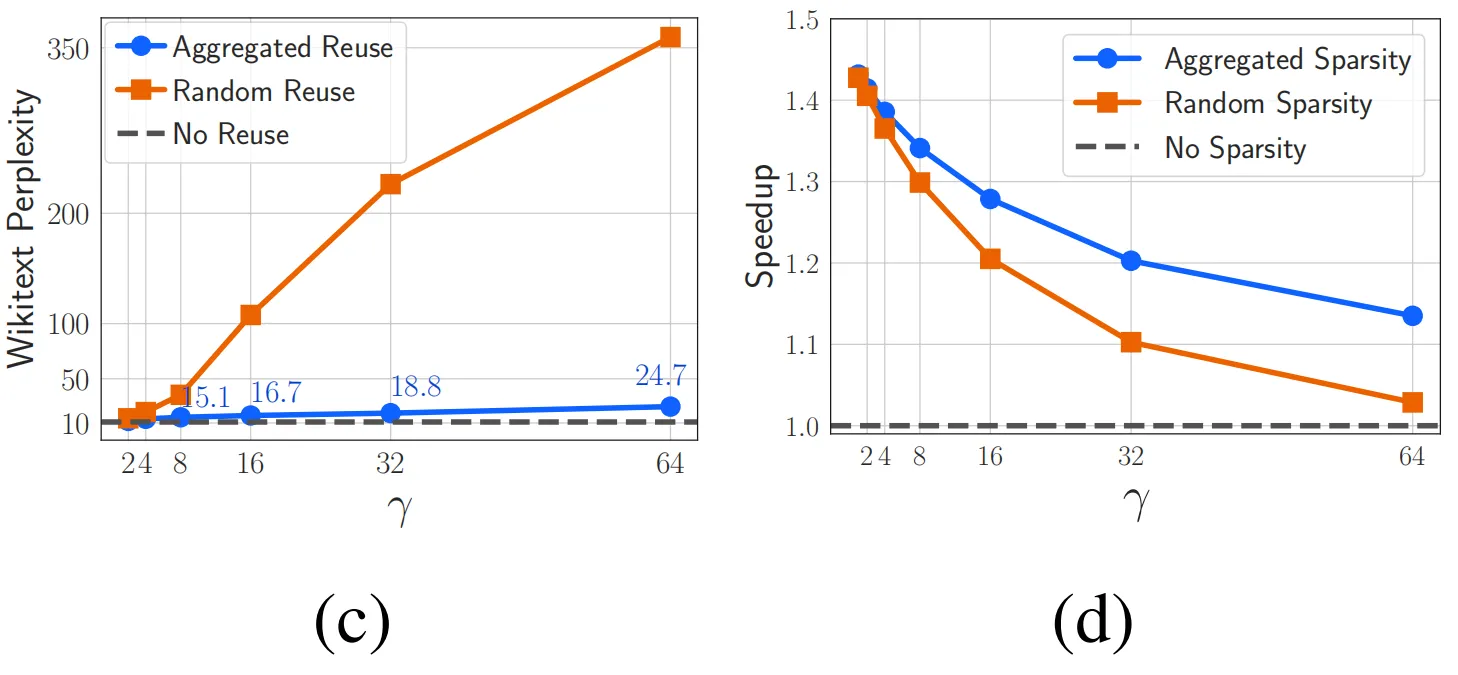

2024/4/12 6:13:24ICLR 2024|ReLU激活函数的反击,稀疏性仍然是提升LLM效率的利器

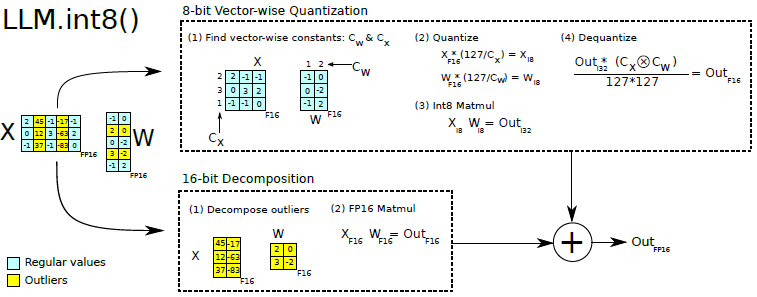

论文题目: ReLU Strikes Back: Exploiting Activation Sparsity in Large Language Models 论文链接: https://arxiv.org/abs/2310.04564 参数规模超过十亿(1B)的大型语言模型(LLM)已经彻底改变了现阶段人工…

生成式语言大模型压缩技术思考——以ChatGPT为例

ChatGPT引领了生成式语言大模型的应用与技术热潮,首先简单回顾ChatGPT应用范式:将其应用于指定的下游任务时(如知识问答、翻译、编码),ChatGPT需要经历三个阶段的训练(增强人类语境的猜想)&…

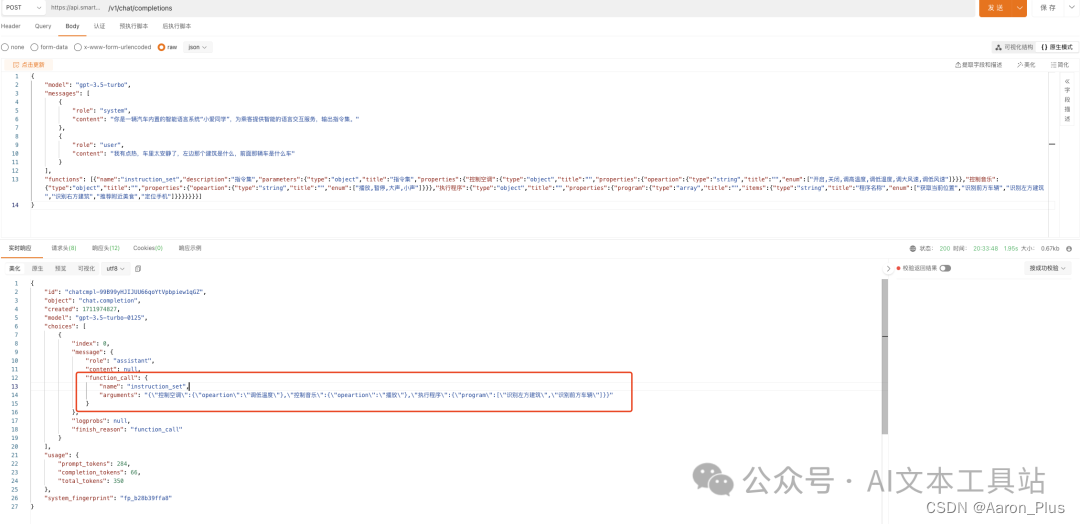

函数调用实现小米汽车智能语音助手

上周小米汽车发布,其中有一个特色功能就是智能语音,小爱同学整合了语音大模型,实现智能座舱体验。

雷老板的PPT也演示了,一些口语化的对话就能触发各种指令,无论是开空调、播放音乐,还是找手机、识别前方汽…

chatglm2-6b微调实战

chatglm2-6b-sft

chatglm2-6b, chatglm-6b微调/LORA/推理

源码地址:https://github.com/yongzhuo/ChatGLM2-SFT

踩坑

1. torch>2.0, 否则微调会报很多错误(单纯推理可以用低版本);

2. tokenizer.encode输出为 [gMASK, sop, 真实文本token]64789 {str} [MASK…