机器人

husky

BeanMap

栈/队列

均值算法

jstl

树

子图

gcc

华为云应用魔方

博通蓝牙使能

IAR

transformers

gaussdb

微机原理

Impala

数字化转型

脚本实战

数据内存对齐数

可执行程序

Decoder

2024/4/12 2:24:56Netty之Decoder详解与实战

在这篇博客文章中,我们将深入探讨Netty框架中的一个核心组件——Decoder,并通过示例解释其工作原理及如何在Netty应用程序中使用它来处理网络通信中的数据解码。

1. 什么是Decoder?

在Netty中,Decoder是一种特殊类型的ChannelHa…

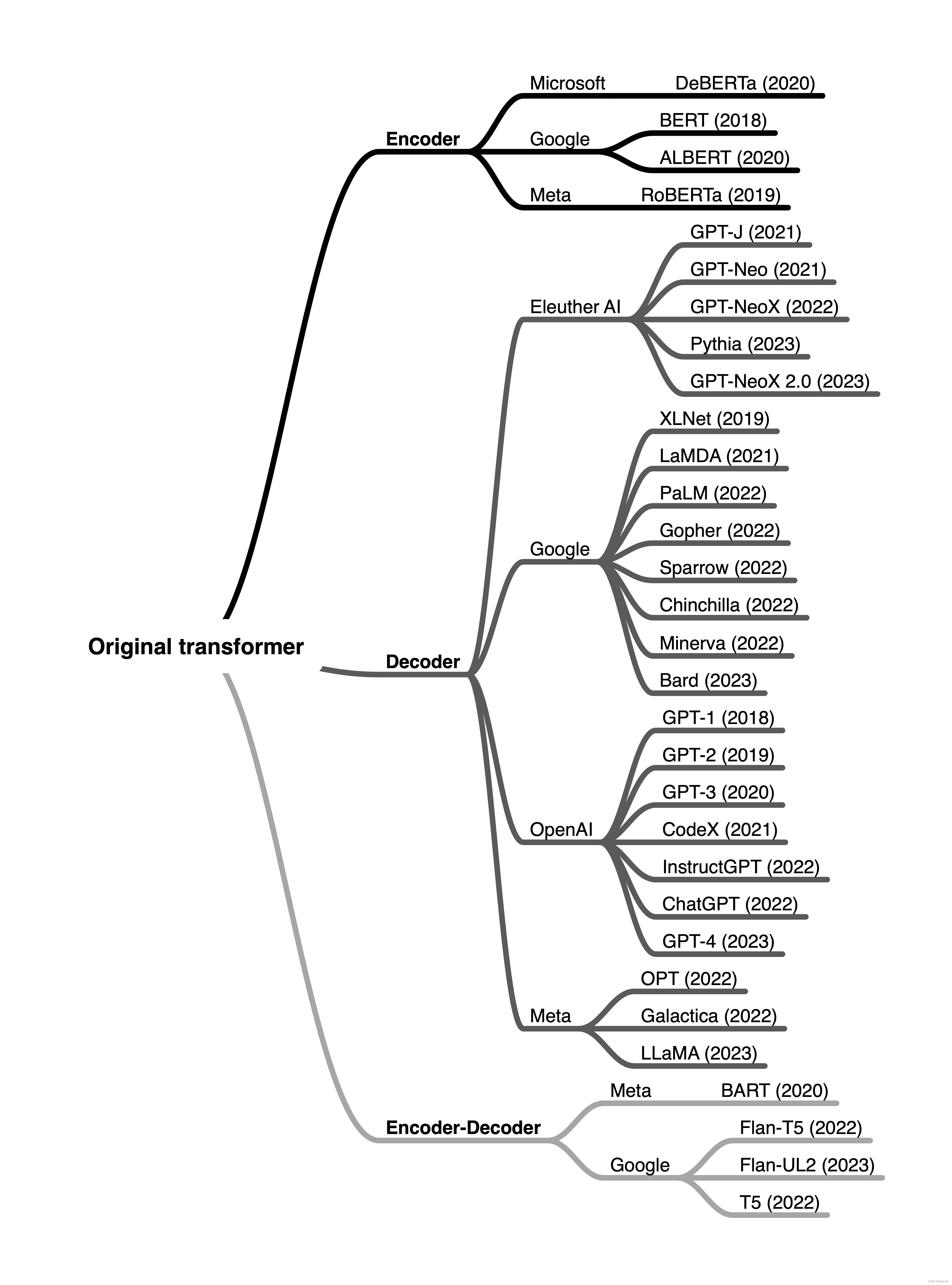

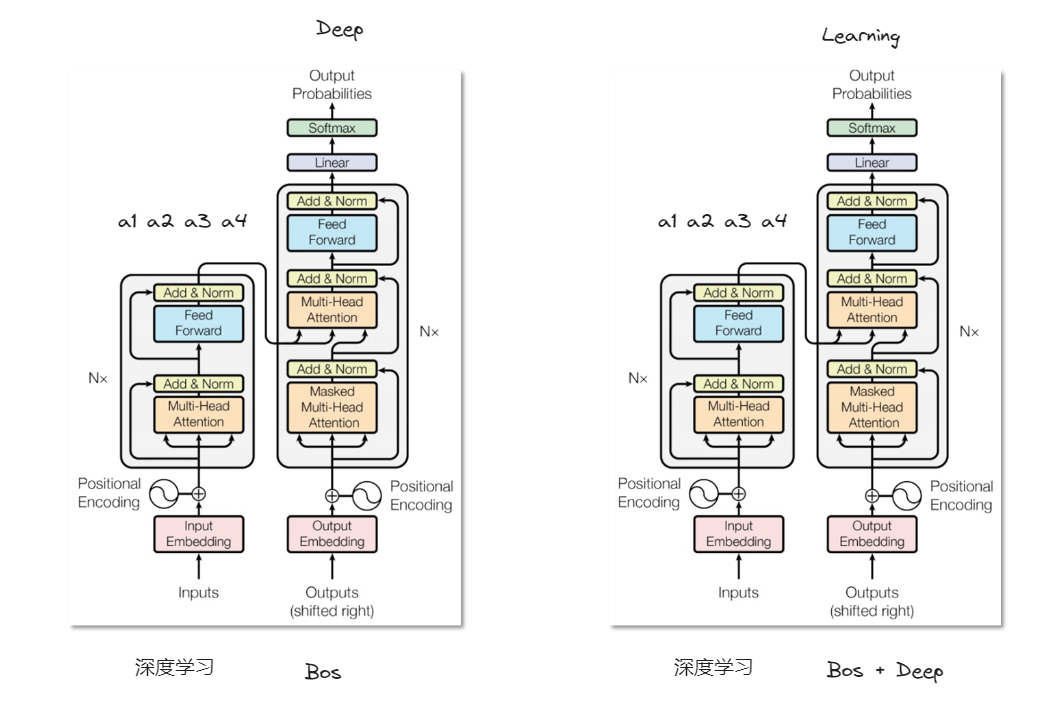

Encoder、Decoder和Encoder-Decoder

首先LLM有3种架构:Encoder-only、Decoder-only、encode-decode

整体情况

1、Encoder将可变长度的输入序列编码成一个固定长度的向量,比如在bert中应用的encoder,其实是输入和输出是等长的向量。通常情况下,encoder是用来提取特征…

2020解决表格重载tableIns.reload序列化serialize()后 前端给后端传中文时的中文乱码问题

解决表格重载tableIns.reload序列化serialize()后 前端给后端传中文时的中文乱码问题

最近遇到的问题,使用表格序列化serialize()后,表格重载发送数据,后台无法接收中文问题

处理函数 前端 前端查询无结果,f12看下控制台&…

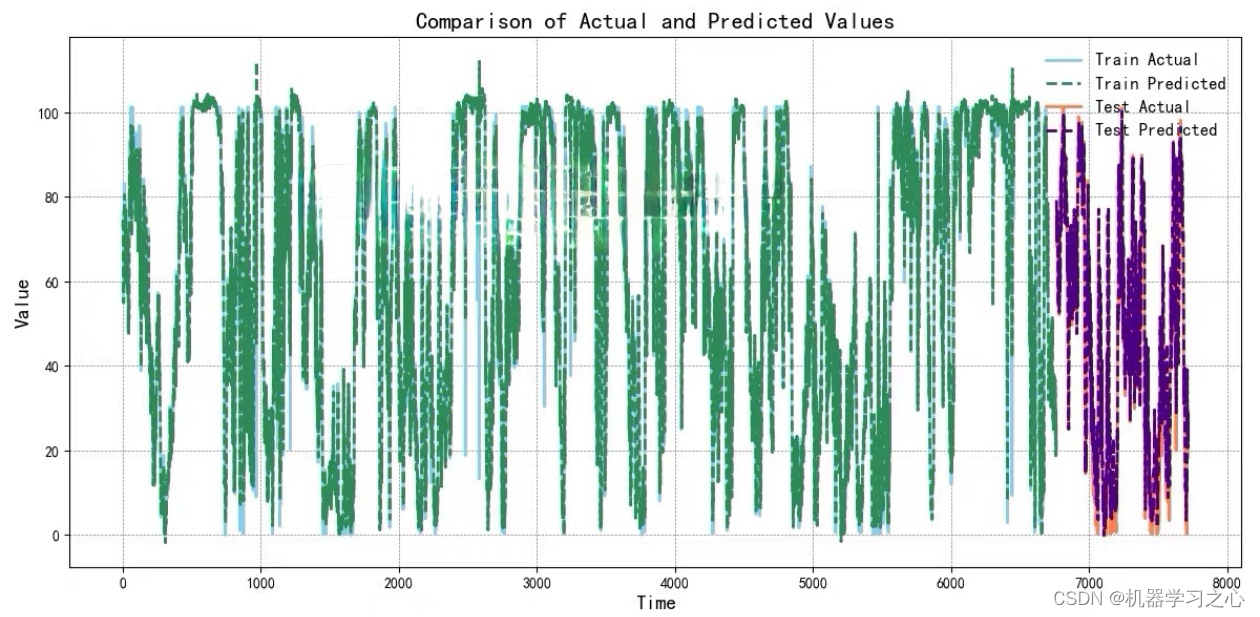

回归预测 | Python基于Encoder-TCN-BIGRU-Decoder多变量回归预测

目录 效果一览基本介绍程序设计参考资料 效果一览 基本介绍 1.支持多输入,单输出! 2.使用了多种可视化方法,代码编写过程中也对各段代码进行封装,方便解读和调试! 3.适合于风电数据,光伏数据,环…

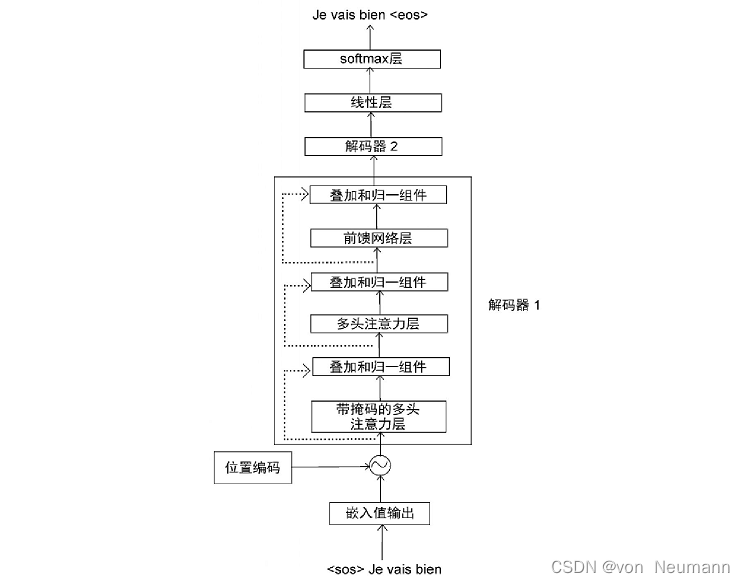

深入理解深度学习——Transformer:解码器(Decoder)部分

分类目录:《深入理解深度学习》总目录

相关文章: 注意力机制(Attention Mechanism):基础知识 注意力机制(Attention Mechanism):注意力汇聚与Nadaraya-Watson核回归 注意力机制&…

LLM(5) | Encoder 和 Decoder 架构

LLM(5) | Encoder 和 Decoder 架构 文章目录 LLM(5) | Encoder 和 Decoder 架构0. 目的1. 概要2. encoder 和 decoder 风格的 transformer (Encoder- And Decoder-Style Transformers)原始的 transformer (The original transformer)编码器 (Encoders)解码器 (Decoders)编码器和…

【NLP】手把手使用PyTorch实现Transformer以及Transformer-XL

手把手使用PyTorch实现Transformer以及Transformer-XL Abstract of Attention is all you need使用PyTorch实现Transformer1. 构建Encoder-Decoder模型1.1 导入依赖库1.2 创建Encoder-Decoder类1.3 创建Generator类 2. 构建Encoder2.1 定义复制模块的函数2.2 创建Encoder2.3 构…

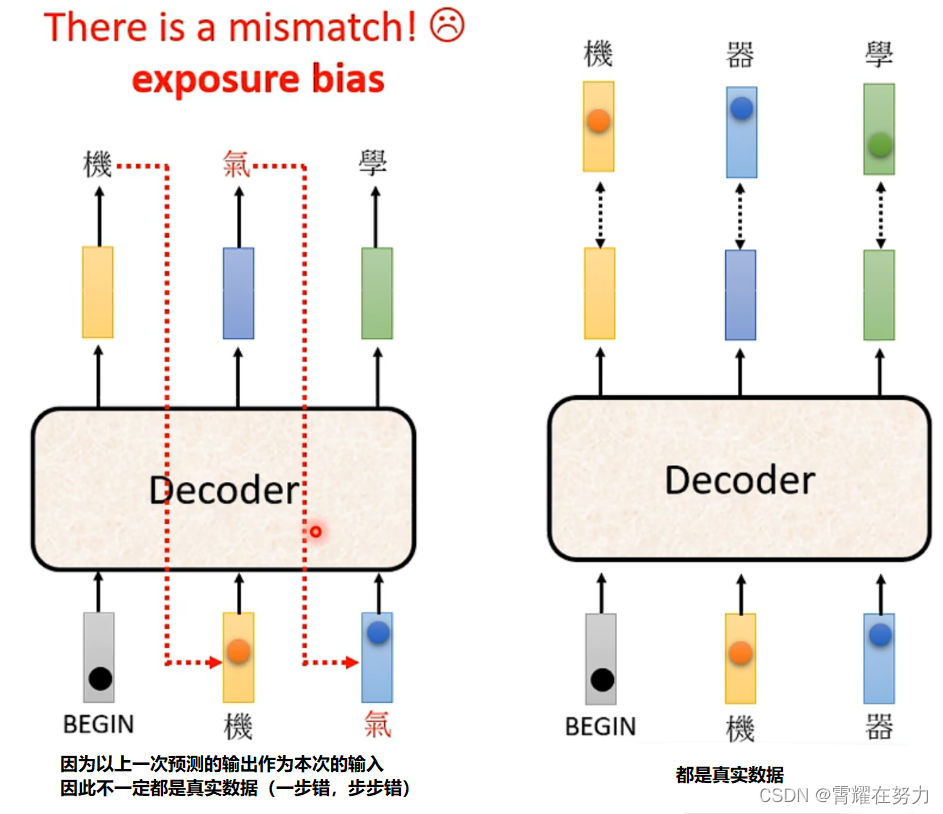

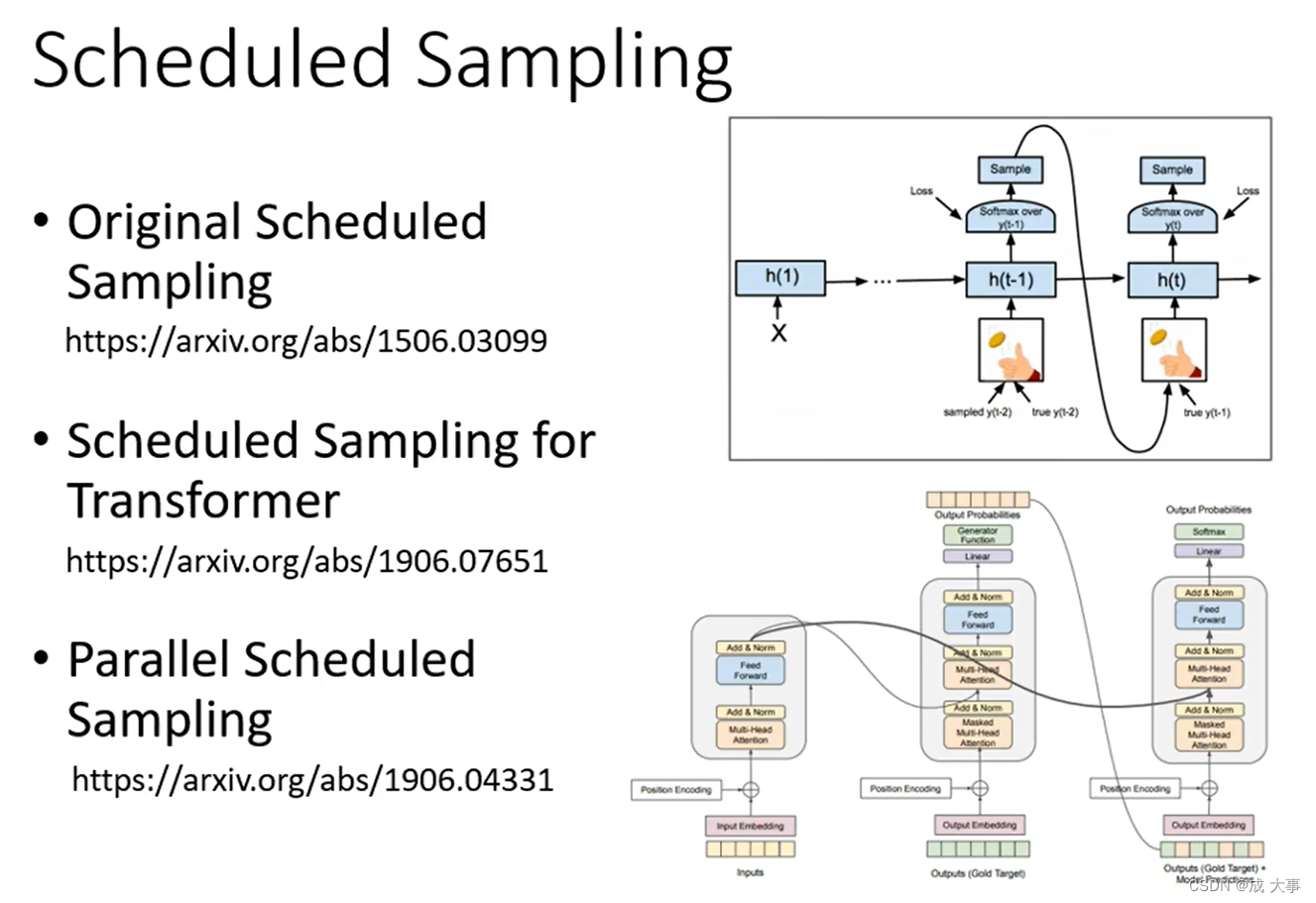

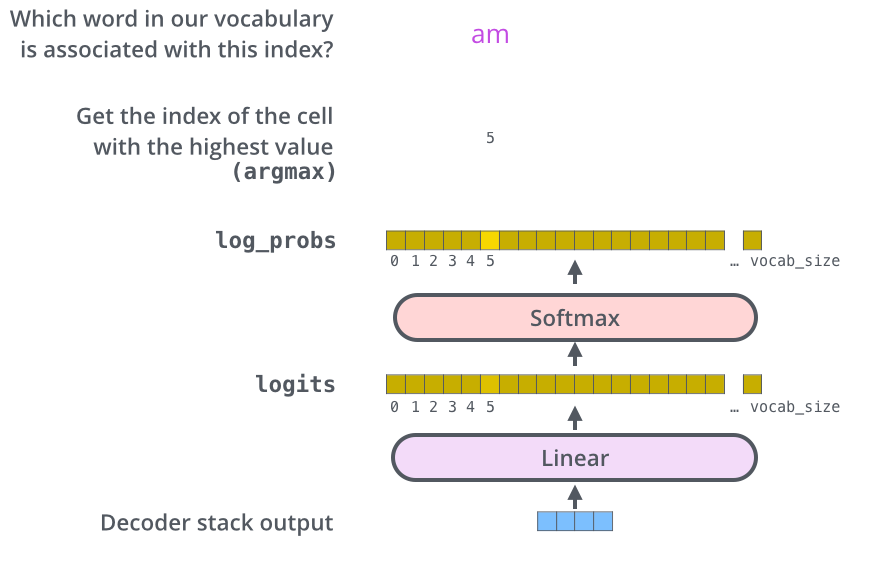

Decoder如何工作、Transformer如何训练、以及exposure bias问题

一、Decoder工作部分(以一个例子介绍工作流程,以及Decoder输出结果是什么样的)Decoder是如何工作的(这也是Decoder与Encoder之间的连接)?Decoder的工作主要涉及到交互注意力,所谓交互注意力是指…

Transformer-深度学习-台湾大学李宏毅-课程笔记

目录 参考Seq2seqSequence-to-sequence(Seq2seq)适用任务语音识别机器翻译语音翻译语音合成聊天机器人自然语言处理硬解任务:文法分析硬解任务:多标签分类硬解任务:目标检测 Sequence-to-sequence(Seq2seq&…

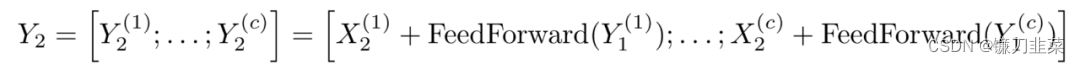

Transformer实战-系列教程2:Transformer算法解读2

🚩🚩🚩Transformer实战-系列教程总目录 有任何问题欢迎在下面留言 Transformer实战-系列教程1:Transformer算法解读1 Transformer实战-系列教程2:Transformer算法解读2

5、Multi-head机制

在4中我们的输入是X&#x…

transformer 模型(self-attention自注意力)

transformer模型在《Attention is all you need》论文中提出

这篇论文主要亮点在于:1)不同于以往主流机器翻译使用基于RNN的seq2seq模型框架,该论文用attention机制代替了RNN搭建了整个模型框架。2)提出了多头注意力(…

【期末考复习向】transformer的运作机制

1.transformer的encoder运作 transformer的encoder部分包括了输入和处理2大部分。首先是输入部分inputs,这里初始的inputs是采用独热向量进行表示的,随后经过word2vec等操作把独热向量(采用独热向量的好处就是可向量是正交的,可以…