基本原理

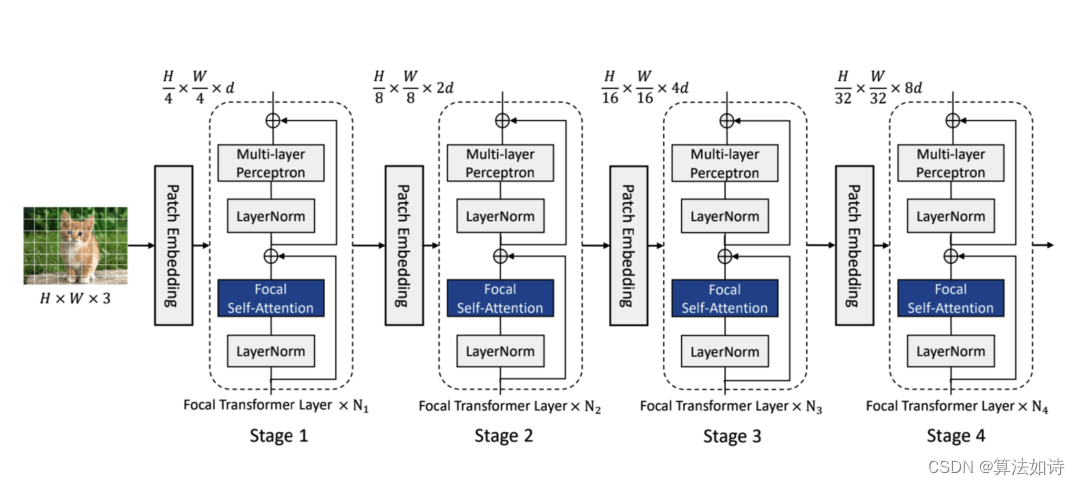

Transformer 是一种使用注意力机制(attention mechanism)的神经网络模型,能够有效地处理序列数据,如句子或文本。

它的设计灵感来自于人类在理解上下文时的方式。

简单来说,Transformer 会将输入的序列分成若干个小块,并通过计算注意力得分来决定每个块在输出中的重要性。

它能够同时处理整个序列,而不需要依赖循环神经网络(RNN)等逐步处理的方法。

巧妙的公式

让我们下面严肃一点,看看Transformer的具体公式。

首先,Transformer由编码器和解码器组成。编码器负责将输入序列转化为抽象的表示,而解码器则根据这个表示生成目标序列。

在编码器中,我们需要计算注意力得分。

这是通过计算查询(query)与键(key)之间的相似度,再乘以值(value)来实现的。然后,我们将这些注意力得分进行归一化处理,并将其加权求和。这个过程可以使用下面的公式表示:

Attention(Q, K, V) = softmax(QK^T / √d_k) * V

其中,Q表示查询向量,K表示键向量,V表示值向量,d_k表示维度数。

接着,我们将注意力得分与输入序列的表示进行加权求和,得到编码器的输出。

案例

这次我们选择一个简单的翻译任务作为示例。

假设我们有一个英