lua

WS2812 5050 RGB

机制与策略

阿克曼

matlab入门案例

Shader

bert

CAS原子锁

kudu读写流程

正射矫正

Impala

图像像素点测量温度

在线聊天室

寄生-捕食算法

微信小程序登录

信号完整性仿真

BFC

颜宁

贝叶斯

虚拟化

【人工智能与深度学习】注意力机制和Transformer

相关文章

全国青少年软件编程(Scratch)等级考试二级考试真题2023年5月——持续更新.....

一、单选题(共25题,共50分) 1.运行下列哪段程序,可以让狗狗走到木屋门口?()

A.

B.

C.

D.

标准答案:C 2.下列哪个选项可以控制:按下左键扫帚向左旋转15度,按下右键扫帚向右旋转15度?()

A.

B.

C.

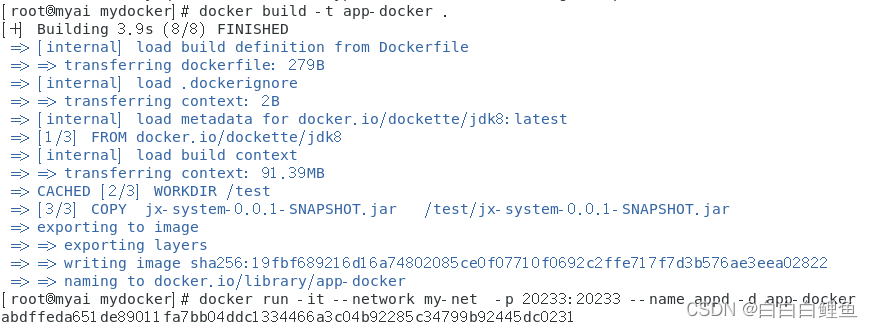

Docker部署——将jar包打成docker镜像并启动容器

在代码编写完成即将部署的时候,如果采用docker容器的方法,需要将jar包打成docker镜像并通过镜像将容器启动起来。具体的步骤如下。

一、首先下载java镜像 先使用docker search java命令进行搜索。 然而在拉取镜像的时候要注意不能直接去选择pull java ,…

阿里P8架构师手码的Java工程师面试小抄在Github火了,完整版限时开源

网上的 JAVA 面试文档更是层出不穷。但是单单刷 JAVA 面试题就足够了吗?

答案显然是不够的!那么为什么呢?

因为现在的程序员就业环境早就和两年前不可同日而语了。 如果你在两年前面试:

就拿 JVM 来说,刷面试题可能…

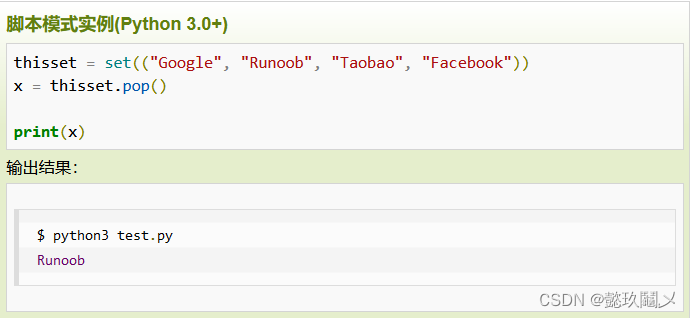

Python3 字典与集合 | 菜鸟教程(七)

目录

一、Python3 字典

(一)字典是另一种可变容器模型,且可存储任意类型对象。

(二)字典的每个键值 key>value 对用冒号 : 分割,每个对之间用逗号(,)分割,整个字典包括在花括号 {} 中 &am…

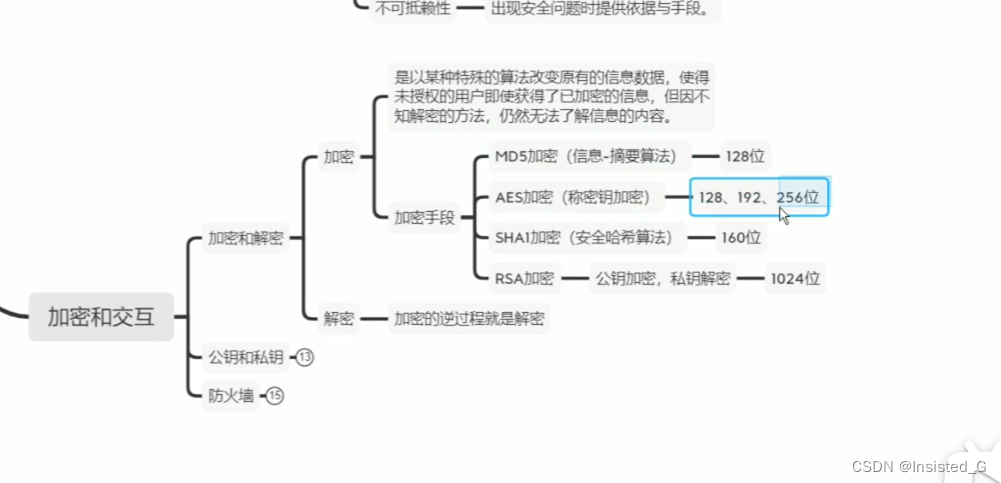

网络层(3)6/12

1.网络层 网络层最大的特点就是提供路由,路由就是分组从源到目的地址时,绝定的端到端的路径 路由:路由是网络层最主要的工作任务 网关:一个网络域到另一个网络域的关卡,主要用于不同网段之间的通讯 路由的获取方式&…

【MySQL入门】-- MySQL的SQL分类:DDL、DML、DQL、DCL快速入门

目录

一、SQL分类

二、讲解DDL、DML、DCL、DQL、TCL

1.常用的DDL(数据定义语言)的操作

2.常用的DML(数据操作语言)的操作

3.常用DCL(数据控制语言)的操作

4.常用DQL(数据查询语言)的操作

5.常用TCL(事务控制语言)的操作 前言: 前面我们已经简单介绍过了数据…

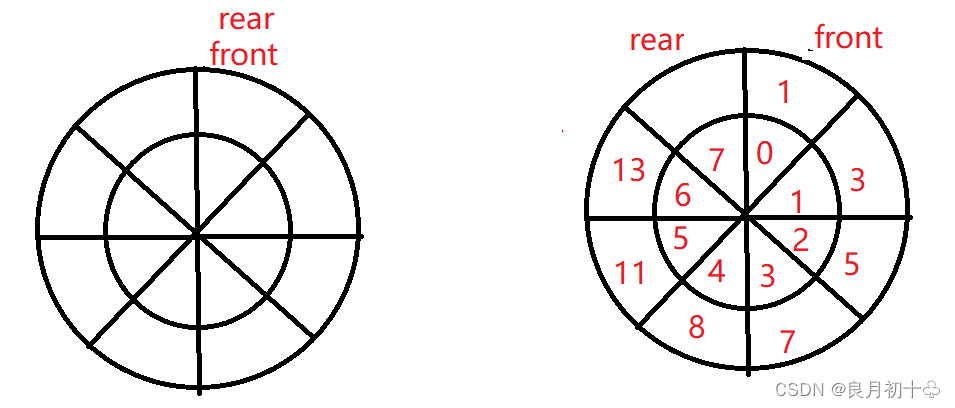

Java集合框架:队列、Queue和Deque详解

目录

一、普通队列

1. 概念

2. Queue(Java集合框架的接口)

3. Queue中的方法

4. 方法使用演示

5. 队列的模拟实现

6. 顺序普通队列的缺点: 二、循环队列

1. 循环队列也是一种数据结构。基于上述队列的缺点,此时就有了循环…

pytest接口测试案例

安装python

安装pytest pip install -u pytest

安装allure pip install allure-pytest -i http://pypi.douban.com/simple/ --trusted-host pypi.douban.com import pytest

import requests

from requests.sessions import sessionmysession requests.session()

myu…

最新文章

- 【C++】【MFC】绘图

- Pandas库学习之DataFrame.head()函数

- Java流的概念及API

- vue3 vue页面根目录增加注释 keep-alive 不生效 需避开此位置

- “信息科技风险管理”和“IT审计智能辅助”两个大模块的部分功能详细介绍:

- 深度解读昇腾CANN小shape算子计算优化技术,进一步减少调度开销

- Android13 应用代码中修改热点默认密码

- 至美女

- Windows 2000 System Services列表(http://webcrazy.yeah.net)

- 描述一下cookies,sessionStorage和localStorage的区别?

- (JavaScript)原型与原型对象

- (四)Java EE 5实现Web服务(Web Services)及多种客户端实例-胖客户端

- .NET/CLR好书推荐