输入端适配

通过patch0与每个patch计算value来整合信息 最后分类

因为transformer的输入输出维度是一致的,transformer block的任何一个输出 无法进行很好的分类

为什么不使用输出patch相加求平均?patch 可能是1616的数量,然后哪怕256256的大小,输出向量也无法接受

位置编码

图像切分重排后丢失位置信息,并且transformer计算无需位置信息

结果分析

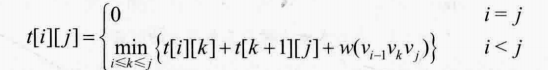

attention的距离等价于Conv中的感受野大小

可以看到越深的层数,attention跨的距离越远

但是在越底层,也有的head可以覆盖很远的距离

这两点可以看到transformer确实在负责global信息整合